Embedding模型完全指南:2026年最佳文本向量化模型选型与RAG应用实践

本文深入解析Embedding模型(嵌入模型)的工作原理,盘点2026年MTEB排行榜上的顶级文本向量化模型,并提供RAG(检索增强生成)应用的完整选型方案。

📋 目录

- 什么是Embedding模型

- Embedding模型工作原理

- 2026年Embedding模型排行榜

- 主流Embedding模型详细对比

- RAG应用中的Embedding选型

- 中文场景优化建议

- 常见问题FAQ

什么是Embedding模型

Embedding模型(嵌入模型)是一种将高维离散数据(如文本、图像、音频)转换为低维连续向量表示的机器学习算法。通过这种转换,语义相似的内容在向量空间中的距离更近,从而实现:

- 语义搜索:理解查询意图,而非简单关键词匹配

- 文本分类:快速归类海量文档

- 语义相似度计算:判断两段文本的相似程度

- RAG检索增强:为大语言模型提供精准的外部知识

为什么Embedding模型如此重要?

在AI大模型时代,Embedding模型是连接非结构化数据与机器理解的桥梁。无论是构建企业知识库、开发智能客服,还是实现多语言搜索,都离不开高质量的文本向量化技术。

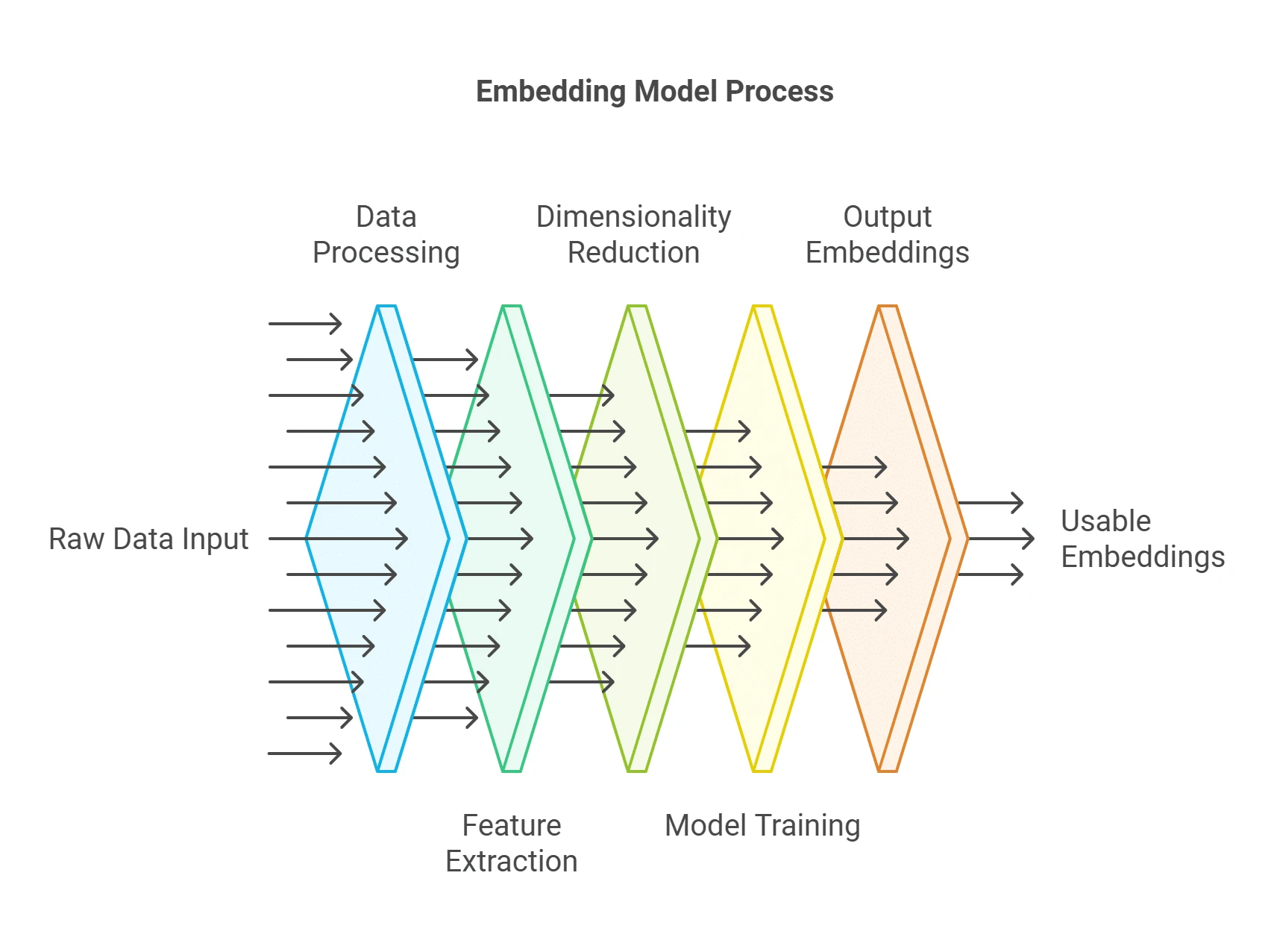

Embedding模型工作原理

文本向量化的基本流程

原始文本 → 分词(Tokenization) → 编码(Encoding) → 向量嵌入(Vector Embedding)

- 分词:将文本拆分为Token(单词或子词单元)

- 编码:通过神经网络(如Transformer)提取语义特征

- 嵌入:生成固定维度的稠密向量(如768维、1024维、3072维)

向量相似度计算

Embedding模型生成的向量通常使用余弦相似度(Cosine Similarity)或欧氏距离(Euclidean Distance)来衡量语义相似性:

| 相似度算法 | 适用场景 | 特点 |

|---|---|---|

| 余弦相似度 | 语义搜索、推荐系统 | 不受向量长度影响,关注方向 |

| 欧氏距离 | 聚类分析、异常检测 | 考虑绝对距离 |

| 点积相似度 | 大规模检索 | 计算效率高 |

2026年Embedding模型排行榜

MTEB基准测试解读

MTEB(Massive Text Embedding Benchmark)是评估Embedding模型最权威的基准测试,涵盖8大类56项任务:

- 分类(Classification):文本分类准确率

- 聚类(Clustering):文档聚类效果

- 成对分类(Pair Classification):判断文本对关系

- 重排序(Reranking):搜索结果重排质量

- 检索(Retrieval):语义搜索召回率

- 语义相似度(STS):句子相似度计算

- 摘要(Summarization):文本摘要质量

综合排名(Overall)

| 排名 | 模型名称 | 厂商 | MTEB v2得分 | 参数量 | 上下文长度 | 开源 |

|---|---|---|---|---|---|---|

| 🥇 1 | Harrier-OSS-v1 | Microsoft | 74.3 | 27B | 8K | ✅ |

| 🥈 2 | NV-Embed-v2 | NVIDIA | 72.31 | 7B | 512 | ✅ |

| 🥉 3 | Jina v5-text-small | Jina AI | 71.7 | 蒸馏版 | 8K | ✅ |

| 4 | Qwen3-Embedding-8B | 阿里巴巴 | 70.58 | 8B | 32K | ✅ |

| 5 | Gemini Embedding 2 | 68.32 | - | 8K | ❌ | |

| 6 | Voyage 4 Large | Voyage AI | 66.8 | - | 32K | ❌ |

| 7 | Cohere embed-v4 | Cohere | 65.2 | - | 128K | ❌ |

| 8 | OpenAI text-embedding-3-large | OpenAI | 64.6 ⚠️ | - | 8K | ❌ |

| 9 | BGE-M3 | BAAI智源 | 63.0 | 568M | 8K | ✅ |

| 10 | Nomic Embed v2 | Nomic AI | 62.5 | 1.2B | 8K | ✅ |

⚠️ 注意:OpenAI text-embedding-3-large自2024年1月后未更新,已被多个新模型超越

英文排名(English MTEB)

| 排名 | 模型名称 | MTEB得分 | 特点 |

|---|---|---|---|

| 🥇 1 | Gemini Embedding 2 | 68.32 | 多模态,检索得分67.71 |

| 🥈 2 | NV-Embed-v2 | 72.31 | 英文任务专项优化 |

| 🥉 3 | Voyage 4 Large | 66.8 | 长上下文32K |

| 4 | Cohere embed-v4 | 65.2 | 128K超长上下文 |

| 5 | OpenAI text-embedding-3-large | 64.6 | 3072维,Matryoshka支持 |

多语言排名(Multilingual MTEB)

| 排名 | 模型名称 | 厂商 | 得分 | 支持语言 |

|---|---|---|---|---|

| 🥇 1 | Llama-Embed-Nemotron-8B | NVIDIA | 第一 | 多语言专项优化 |

| 🥈 2 | Harrier-OSS-v1 | Microsoft | 74.3 | 94种语言 |

| 🥉 3 | Jina v5-text-small | Jina AI | 71.7 | 100+语言 |

| 4 | Qwen3-Embedding-8B | 阿里巴巴 | 70.58 | 中英为主 |

| 5 | Cohere embed-v4 | Cohere | 65.2 | 100+语言 |

中文排名(Chinese / CMTEB)

| 排名 | 模型名称 | 厂商 | 特点 |

|---|---|---|---|

| 🥇 1 | Qwen3-Embedding-8B | 阿里巴巴 | 中文理解最佳,32K上下文 |

| 🥈 2 | BGE-M3 | BAAI智源 | 三合一检索,中文社区首选 |

| 🥉 3 | Jina v5-text-small | Jina AI | 跨语言对齐优秀 |

| 4 | Harrier-OSS-v1 | Microsoft | 多语言包含中文 |

| 5 | BCEmbedding | 网易有道 | 中英双语RAG专项优化 |

开源排名(Open Source)

| 排名 | 模型名称 | 厂商 | MTEB得分 | 许可 |

|---|---|---|---|---|

| 🥇 1 | Harrier-OSS-v1 | Microsoft | 74.3 | MIT |

| 🥈 2 | NV-Embed-v2 | NVIDIA | 72.31 | 开源权重 |

| 🥉 3 | Jina v5-text-small | Jina AI | 71.7 | Apache 2.0 |

| 4 | Qwen3-Embedding-8B | 阿里巴巴 | 70.58 | Apache 2.0 |

| 5 | Llama-Embed-Nemotron-8B | NVIDIA | 多语言第一 | 开源权重 |

| 6 | BGE-M3 | BAAI智源 | 63.0 | MIT |

| 7 | Nomic Embed v2 | Nomic AI | 62.5 | Apache 2.0 |

闭源排名(Commercial API)

| 排名 | 模型名称 | 厂商 | MTEB得分 | 价格 |

|---|---|---|---|---|

| 🥇 1 | Gemini Embedding 2 | 68.32 | 按量计费 | |

| 🥈 2 | Voyage 4 Large | Voyage AI | 66.8 | $0.50/1M tokens |

| 🥉 3 | Cohere embed-v4 | Cohere | 65.2 | $0.10/1M tokens |

| 4 | OpenAI text-embedding-3-large | OpenAI | 64.6 | $0.13/1M tokens |

| 5 | text-embedding-3-small | OpenAI | 62.3 | $0.02/1M tokens |

主流Embedding模型详细对比

🏆 开源模型推荐

1. BGE-M3(智源研究院)

最适合:中文RAG应用、混合检索、边缘部署

| 特性 | 详情 |

|---|---|

| MTEB得分 | 63.0 |

| 支持语言 | 100+种语言 |

| 向量维度 | 1024(可降维) |

| 上下文长度 | 8192 tokens |

| 检索方式 | 稠密+稀疏+多向量 |

| 开源许可 | MIT |

| Workers AI | @cf/baai/bge-m3 |

优势:

- 支持混合检索(Dense + Sparse + Multi-vector)

- 中文优化出色,国内部署首选

- 轻量级(568M参数),推理速度快

- Cloudflare Workers原生支持,边缘部署零配置

使用示例:

from FlagEmbedding import BGEM3FlagModel

model = BGEM3FlagModel('BAAI/bge-m3')

sentences = ["什么是Embedding模型", "文本向量化技术"]

embeddings = model.encode(sentences)

Cloudflare Workers部署:

const embedding = await env.AI.run('@cf/baai/bge-m3', {

text: ["什么是Embedding模型"]

});

2. Jina Embeddings v5

最适合:长文档处理、多语言场景

| 特性 | v5-text-small | v5-text-base |

|---|---|---|

| MTEB得分 | 71.7 | 69.5 |

| 上下文长度 | 8192 | 8192 |

| 向量维度 | 1024 | 1024 |

| 模型大小 | 蒸馏版 | 1.2B |

优势:

- 长文档支持优秀(8192 tokens)

- 多语言能力强

- 提供超轻量版(nano)适合边缘设备

3. Qwen3-Embedding-8B(阿里巴巴)

最适合:中文企业级应用

| 特性 | 详情 |

|---|---|

| MTEB得分 | 70.58 |

| 上下文长度 | 32K |

| 向量维度 | 3584 |

| 支持语言 | 中英为主 |

| Workers AI | @cf/qwen/qwen3-embedding-0.6b |

优势:

- 超长上下文(32K)

- 中文语义理解精准

- 与Qwen大模型生态深度整合

- 支持Cloudflare Workers边缘部署

💼 商业API模型推荐

1. OpenAI text-embedding-3-large

最适合:通用场景、快速接入

| 特性 | 详情 |

|---|---|

| MTEB得分 | 64.6 |

| 向量维度 | 3072(支持Matryoshka降维) |

| 上下文长度 | 8192 |

| 价格 | $0.13 / 1M tokens |

优势:

- Matryoshka表示支持灵活降维(3072→256维)

- 质量稳定,生态完善

- 与OpenAI GPT模型配合最佳

2. Cohere embed-v4

最适合:多语言应用、超长文档

| 特性 | 详情 |

|---|---|

| MTEB得分 | 65.2 |

| 上下文长度 | 128K(业界最长) |

| 支持语言 | 100+种 |

| 价格 | $0.10 / 1M tokens |

优势:

- 超长上下文(128K tokens)

- 多语言支持优秀

- 性价比高于OpenAI

3. Gemini Embedding 2(Google)

最适合:多模态应用

| 特性 | 详情 |

|---|---|

| MTEB得分 | 68.32 |

| 多模态支持 | 文本、图像、视频、音频、PDF |

| 向量维度 | 统一向量空间 |

优势:

- 业界领先的多模态Embedding能力

- 统一向量空间支持跨模态检索

- 与Gemini大模型深度整合

Cloudflare Workers边缘部署推荐

Cloudflare Workers AI提供了一系列针对边缘计算优化的Embedding模型,适合构建低延迟、全球分布的AI应用。

Cloudflare Workers AI 模型列表(2026年4月)

| 模型 | Workers AI标识 | 参数量 | 向量维度 | 上下文长度 | 特点 |

|---|---|---|---|---|---|

| BGE-M3 | @cf/baai/bge-m3 |

568M | 1024 | 8K | 支持稠密+稀疏+多向量检索 |

| EmbeddingGemma | @cf/google/embeddinggemma-300m |

300M | 768 | 8K | Google出品,100+语言支持 |

| Qwen3-Embedding | @cf/qwen/qwen3-embedding-0.6b |

0.6B | 1024 | 4K | 适合长文本索引 |

Cloudflare Workers部署示例

// 使用BGE-M3生成Embedding

const embedding = await env.AI.run('@cf/baai/bge-m3', {

text: ["什么是Embedding模型", "文本向量化技术"]

});

// 存储到Vectorize向量数据库

await env.VECTORIZE.insert([

{ id: "1", values: embedding.data[0] },

{ id: "2", values: embedding.data[1] }

]);

边缘部署优势

| 特性 | 说明 |

|---|---|

| 全球低延迟 | 330+城市边缘节点,就近推理 |

| 高并发 | 小模型支持1500-3000 req/min |

| 零冷启动 | 毫秒级响应 |

| 与Vectorize无缝集成 | 原生向量数据库支持 |

| 免费额度 | 每天10,000次Embedding调用 |

RAG应用中的Embedding选型

RAG架构中的Embedding角色

文档 → Embedding模型 → 向量数据库 → 语义检索 → 大语言模型生成

选型决策树

是否需要中文优化?

├── 是 → 选择 BGE-M3 或 Qwen3-Embedding

└── 否 → 是否需要多语言?

├── 是 → Cohere embed-v4 或 Jina v5

└── 否 → 是否需要开源?

├── 是 → BGE-M3 或 NV-Embed

└── 否 → OpenAI text-embedding-3-large

不同场景的推荐方案

| 应用场景 | 推荐模型 | 理由 |

|---|---|---|

| 中文知识库 | BGE-M3 | 中文优化最佳,支持混合检索 |

| 多语言客服 | Cohere embed-v4 | 100+语言支持,128K长上下文 |

| 代码检索 | Voyage 4 Large | 代码领域专用优化 |

| 快速原型 | OpenAI text-embedding-3-small | 成本低,接入简单 |

| 企业私有化 | BGE-M3 / Qwen3-Embedding | 开源可本地部署 |

| 多模态RAG | Gemini Embedding 2 | 支持图文混合检索 |

| 边缘/Serverless部署 | BGE-M3 / EmbeddingGemma | Cloudflare Workers原生支持,全球低延迟 |

中文场景优化建议

1. 分词优化

中文没有天然空格分词,建议使用:

- jieba分词:轻量级中文分词

- BERT-wwm:全词掩码预训练,更适合中文

2. 向量数据库选择

| 数据库 | 特点 | 适用场景 |

|---|---|---|

| Milvus | 功能全面,企业级 | 大规模生产环境 |

| Pinecone | 全托管,易用 | 快速上线 |

| Qdrant | 开源,Rust高性能 | 本地部署 |

| Weaviate | 模块化,GraphQL | 复杂查询场景 |

| pgvector | PostgreSQL扩展 | 已有PG基础设施 |

3. 检索优化技巧

# 混合检索示例(稠密+稀疏)

from FlagEmbedding import BGEM3FlagModel

model = BGEM3FlagModel('BAAI/bge-m3')

# 同时获取稠密向量和稀疏表示

output = model.encode(

queries,

return_dense=True,

return_sparse=True,

return_colbert_vecs=True

)

常见问题FAQ

Q1: Embedding模型的向量维度越高越好吗?

不是。高维向量(如3072维)确实能捕获更丰富的语义信息,但会带来:

- 存储成本增加

- 检索速度下降

- 向量数据库压力增大

建议:根据实际场景选择,一般768-1024维已能满足大多数需求。

Q2: 如何评估Embedding模型在我的数据上的效果?

步骤:

- 准备领域相关的测试集(查询-文档对)

- 计算Top-K召回率(Recall@K)

- 对比不同模型的检索准确率

- 结合实际业务指标(如用户满意度)

Q3: 同一个Embedding模型可以用于查询和文档吗?

大部分情况可以,但部分模型(如Voyage系列)提供非对称Embedding:

- 查询使用轻量级模型

- 文档使用重量级模型

- 共享向量空间,兼顾效率与质量

Q4: Embedding模型需要微调吗?

一般不需要,但以下情况建议微调:

- 领域术语特殊(如医疗、法律)

- 检索效果不达预期

- 有充足的领域标注数据

Q5: 如何降低Embedding成本?

策略:

- 使用开源模型本地部署(BGE-M3)

- 选择小维度模型(text-embedding-3-small)

- 缓存热门查询的向量结果

- 批量处理减少API调用次数

总结与展望

2026年的Embedding模型市场呈现以下趋势:

- 开源模型崛起:BGE-M3、Jina v5等开源模型性能已接近商业API

- 多模态融合:Gemini Embedding 2引领图文音视频统一Embedding

- 长上下文竞争:从8K到128K,上下文长度持续扩展

- 专业化细分:代码、法律、医疗等垂直领域专用模型涌现

选型建议:

- 中文场景首选:BGE-M3

- 快速接入首选:OpenAI text-embedding-3-large

- 多语言首选:Cohere embed-v4

- 长文档首选:Jina v5 或 Cohere embed-v4

- 边缘部署首选:BGE-M3(Cloudflare Workers)或 EmbeddingGemma

本文最后更新:2026年4月18日

参考资料:MTEB Leaderboard、各厂商官方文档、社区基准测试

关键词:embedding模型, 文本向量化, 向量嵌入, RAG, MTEB, 语义搜索, 向量数据库, BGE-M3, OpenAI Embedding, Cohere, 中文Embedding, 检索增强生成